黑洞——人类当前认知中最神秘的宇宙天体。100多年前爱因斯坦的广义相对论就预测到它的存在,但直到2019年4月人类才获得了第一张黑洞照片。能够给黑洞拍照无疑是解锁了人类科技树上的新技能,如果你也和我一样好奇的话,本文就和大家分享一些给黑洞拍照背后的故事。

1. 当我们给黑洞拍照时,我们在拍什么?

黑洞本身并不发光,也不会向外发出任何电磁辐射(除了还未被证实的霍金辐射),即使以宇宙中最快的光速运动也无法逃脱它的引力束缚。那对着它拍照岂不是什么也看不到?黑洞照片上那朦胧的橘色轮廓又是什么?要想知道给黑洞拍照的真相,我们先回顾一下黑洞的结构。

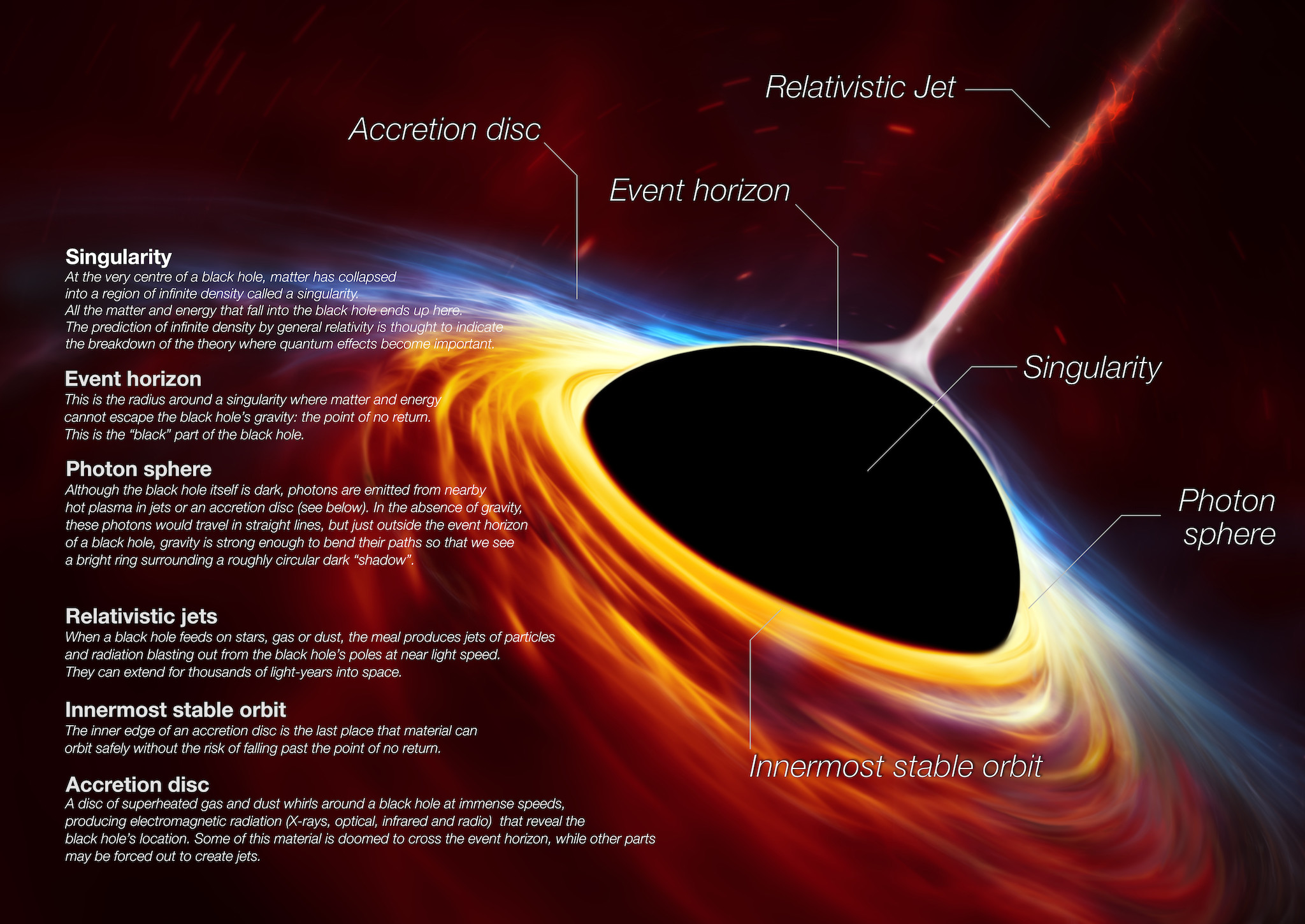

根据上面这张欧洲南方天文台(The European Southern Observatory,简称ESO)给出的假想图可以看出,一个典型黑洞是由奇点,事件视界,光子球,相对论性喷流,最内侧稳定轨道,吸积盘等组成。简单来说,黑洞有两个最基本的部分。第一个是奇点(singularity),即黑洞的中心点,也是落入黑洞物质命运的终点。这是一个体积无限小,密度无限大的引力异常点,此处的空间和时间已经被扭曲到所有的已知物理定律,包括预言它存在的广义相对论都不再适用;第二个是事件视界(event horizon),可以把它理解成一个无形的边界,在这个边界上逃逸速度正好等于宇宙中最快的光速,所以一旦进入这个边界内部,就再也无法逃出黑洞。在万有引力常数不变的情况下,逃逸速度只和物体的质量还有半径(体积)有关。地球的逃逸速度即第二宇宙速度是11.2千米/秒。如果把地球压缩到半径9毫米以下的体积,那么它的逃逸速度就会大于光速,也就变成了一个黑洞。这个临界值可以简单理解为是任何物体自身的事件视界到奇点的距离即史瓦西半径,如果把一个物体压缩成球体的话,只要半径小于史瓦西半径,它就可以变成一个黑洞。太阳的史瓦西半径是3千米,一个人的史瓦西半径大概是10-26米(比电子还要小一亿倍)。

黑洞在“吞噬”其周围物质时会形成高速旋转的吸积盘(accretion disc)。它是黑洞周围的气体或尘埃受到黑洞引力影响跟着一起旋转,当其角动量足够大即旋转足够快时,在一些特定的位置,产生的离心力能够和黑洞的引力相抗衡,从而形成的一种盘状结构。吸积盘内的气体因为高速旋转会产生超高温,从而向外辐射大量能量,也就是人类观察到黑洞发出的电磁波的主要来源。当黑洞吸积物质过快时,吸积盘的磁场会沿着黑洞自转方向扭曲,一些粒子就会以极高的动量(甚至接近光速)喷射出去,形成相对论性喷流(relativistic jets)。

因此,给黑洞拍照主要是在不可见光波段,观测黑洞的吸积盘及喷流产生的电磁辐射。

2. 人类迄今为止拍摄到唯二的黑洞照片

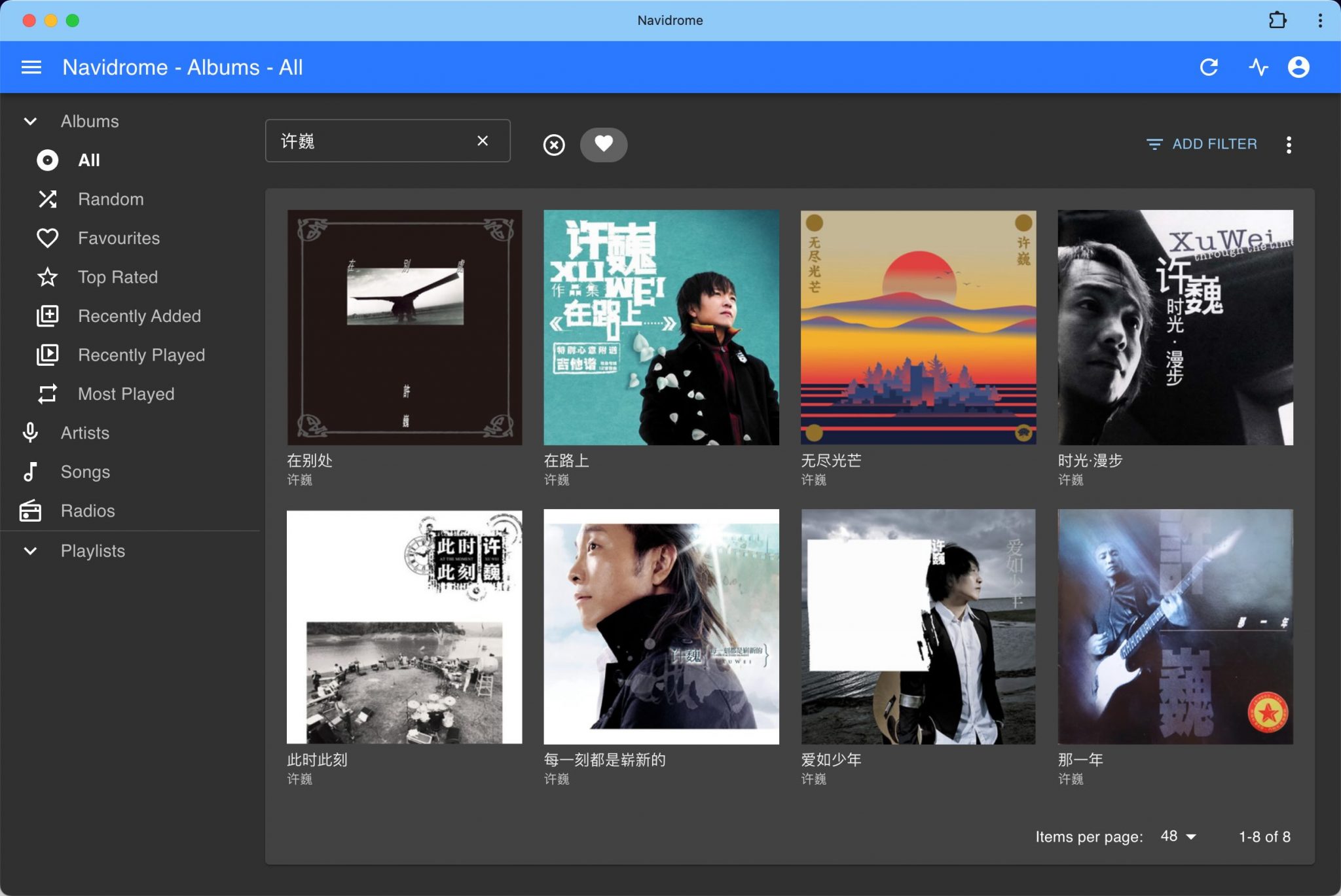

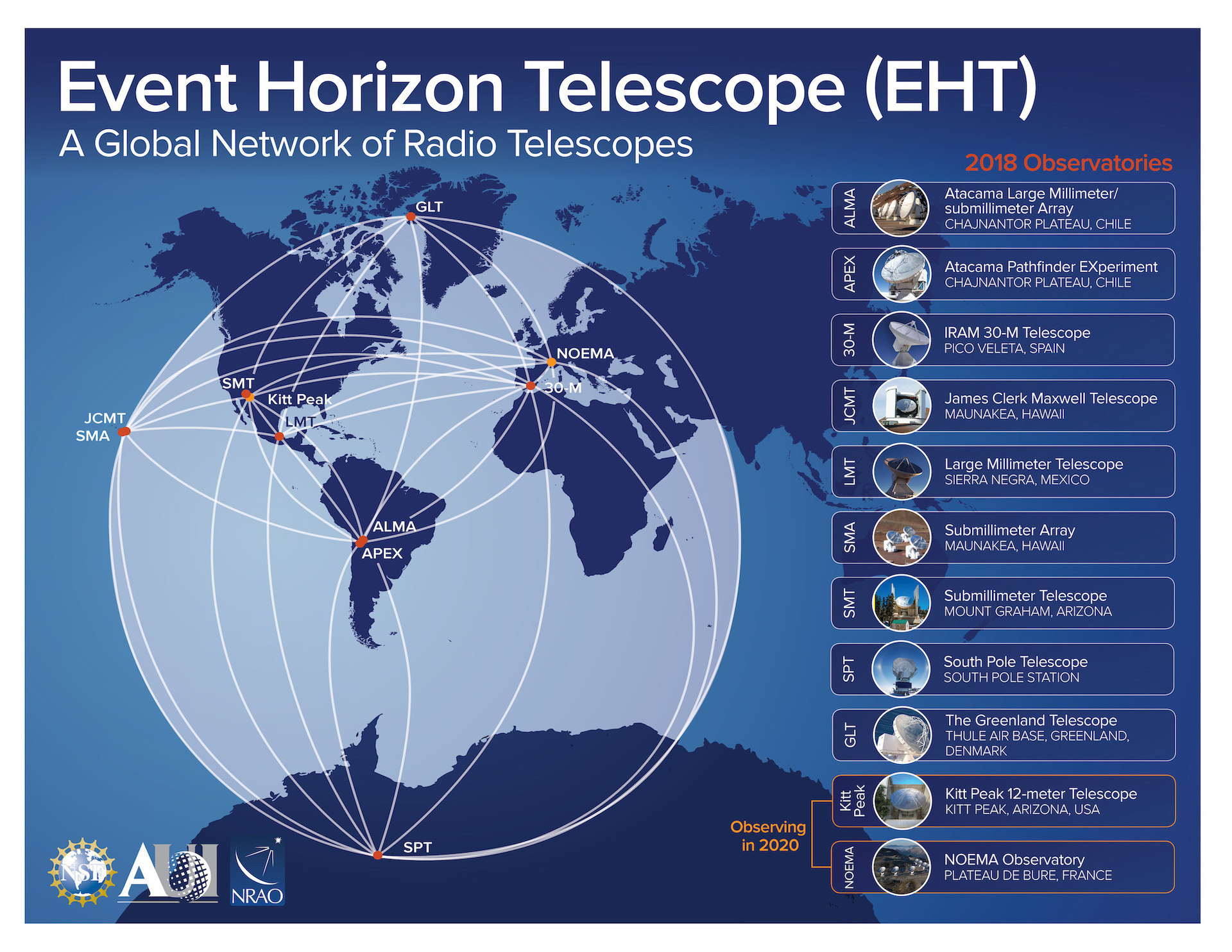

截至目前,人类只拍到过两张黑洞照片,都是由事件视界望远镜(Event Horizon Telescope,简称EHT)组织拍摄、整理、发布。EHT成立于2009年,专门以观测拍摄黑洞为使命,目前由超过20个国家和地区,60个科研机构的300多名科学家组成。

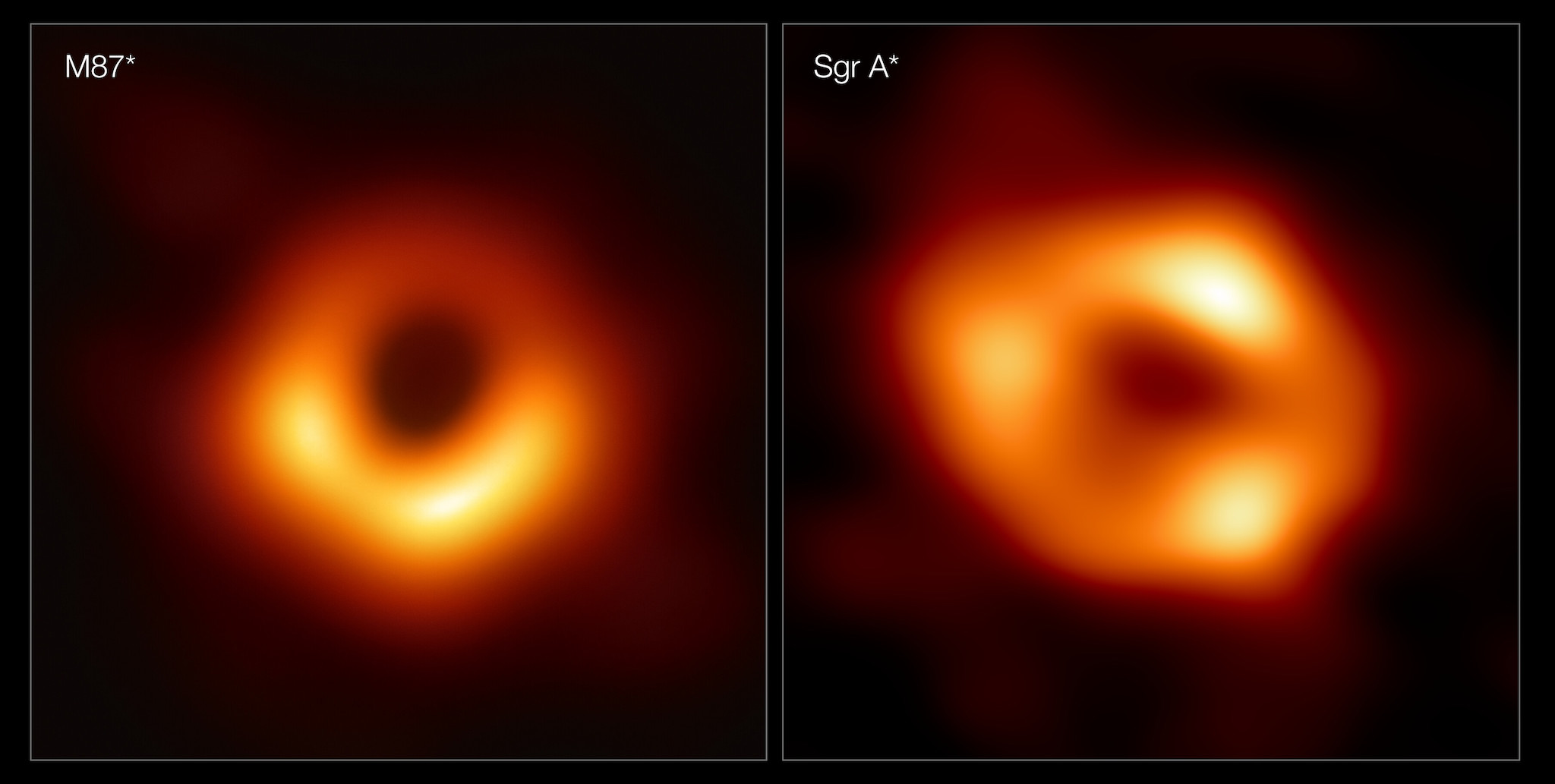

这两张照片分别是2019年4月10日发布的Messier 87(室女A)星系中心超大质量黑洞(简称M87*)照片,以及2022年5月12日发布的我们银河系中心人马座A(Sagittarius A)方向的超大质量黑洞(简称Sgr A*或银心黑洞)照片。这里的星号借鉴了原子物理中激发态(excited state)的概念,表示该天体处于非常活跃的状态。

两图中心黑色阴影部分并不是事件视界的范围,而是大约黑洞史瓦西半径的2.6倍大小,橘色亮斑代表吸积盘上的气体向着接近我们的方向旋转,暗部则反之(多普勒效应)。至于为什么银心黑洞上有三个亮斑,目前还未能确认其产生原因。

下面是这两个黑洞的一些基本情况:

M87* Sgr A* 银心黑洞 质量(与太阳相比) 65 亿 倍 410 万 倍 与地球的距离 5300 万 光年 26600 光年

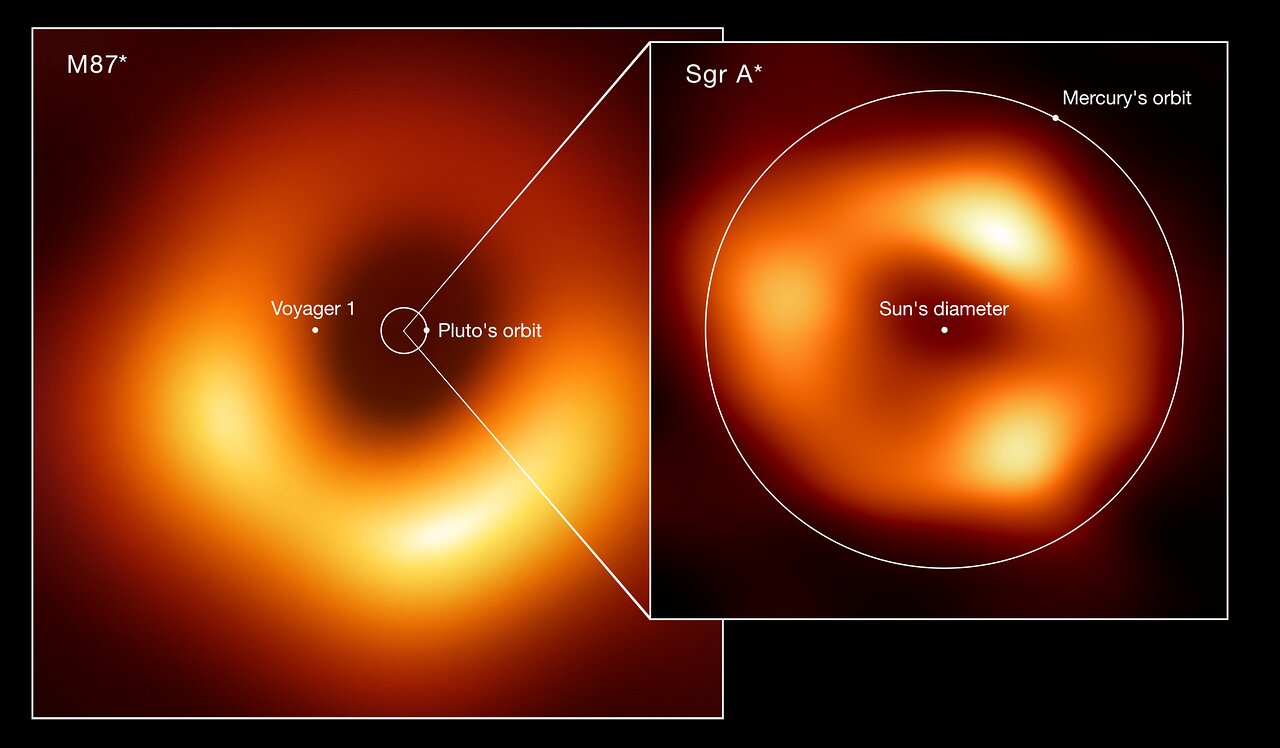

再看看两个黑洞的大小。下图中右侧中心的小白点是太阳,银心黑洞外围(吸积盘)的面积,与水星轨道面积相当;左侧是M87*,图中白色小圆圈是冥王星的轨道面积,白色小点是1977年发射的旅行者1号,目前距离地球最远的人造探测器的位置。

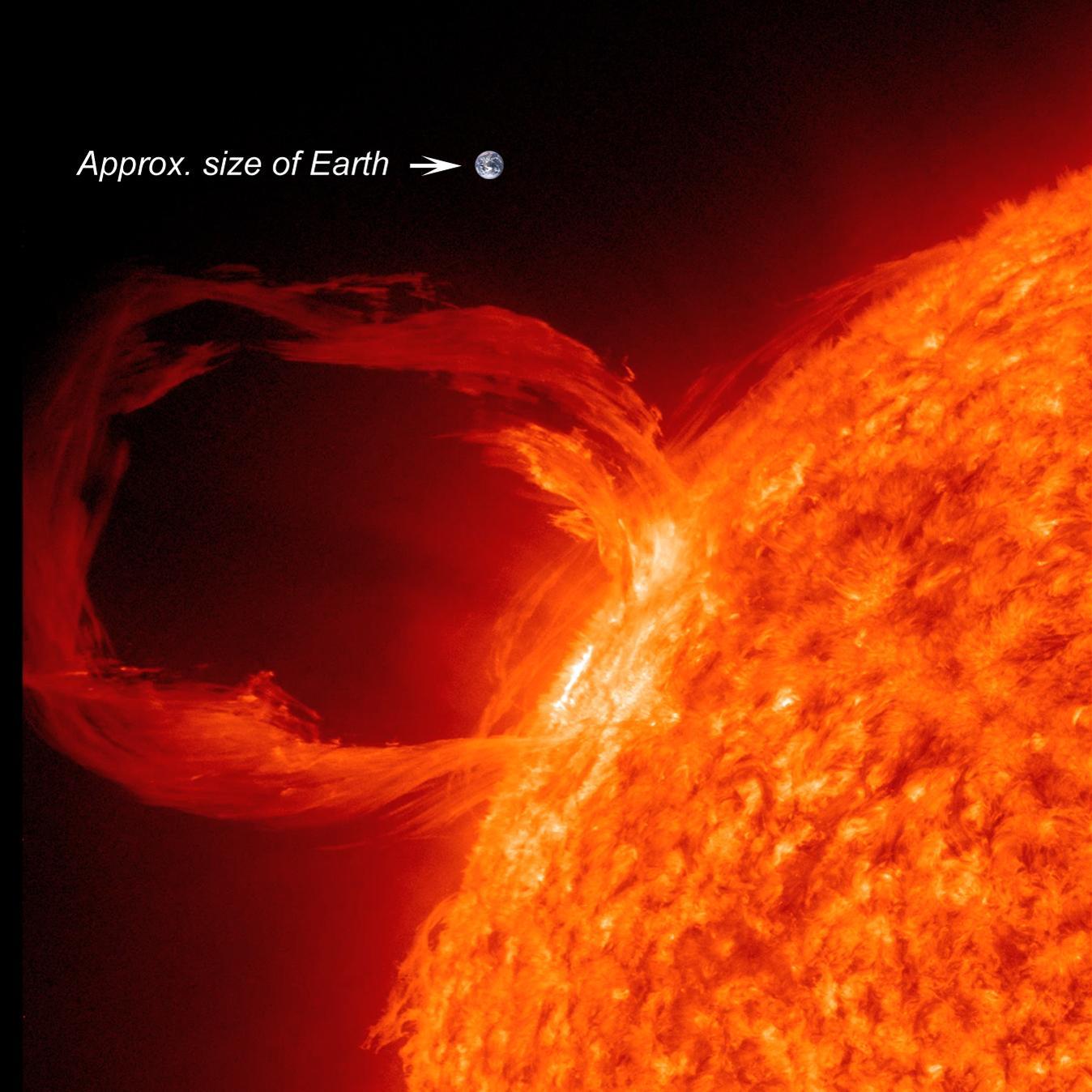

如果上面的表格中数字太大或黑洞体积还是不直观的话,我们把太阳放大看看可能会容易理解一些。

实际上这两张黑洞照片的“拍摄”时间都是在2017年4月,持续近10天。第一张M87*照片在两年后公布,第二张银心黑洞的照片又等了3年才公布。

3. 给黑洞拍照很难吗?

现在你可能会问,这两个黑洞那么大,怎么还拍得这么不清楚?和《星际穿越》里黑洞的样子相比怎么这么难看?给它们拍照片很难吗?答案是:难,非常难。可谓是拍照10天,修图5年(银心黑洞)。

挑战一:角分辨率

从距离上来说,M87*黑洞虽然距地球比银心黑洞远2000倍,但却比后者要大1000倍。所以从地球望去,视觉效果上两者是差不多大小的。加之一个是我们已知的最大黑洞之一,一个是我们自己星系中心的黑洞,因此EHT选择它俩作为观测目标。它们在天空占据多大的位置(角分辨率)呢?答案是52微角秒(1微角秒=1″ / 1000 / 1000 ),相当从地球观察月球表面一个甜甜圈????。经计算,望远镜的尺寸需要和地球一样大,才可以达到如此的拍摄分辨率。

挑战二:超大数据量

对黑洞的观测每天每个观测点产生的数据量可达350TB,科学家们需要足够的耐心和时间来处理这些数据。

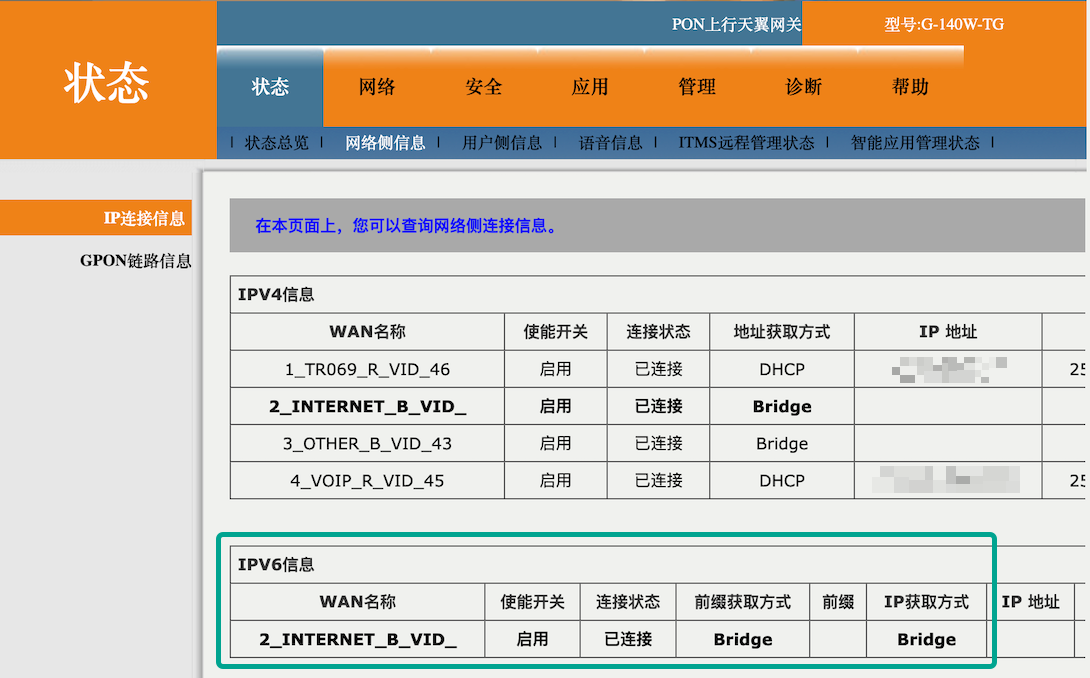

银心黑洞附加题一:尘埃带遮挡

由于太阳系位于银河系的盘面上,向银河系中心望去时,存在很多遮挡物,这是由星际尘埃和气体组成的尘埃带,使得银心处的可见光,紫外线和部分X射线都无法到达地球。尘埃带一般常见于漩涡星系或棒旋星系(比如银河系)。而M87星系是椭圆星系,完全不受银河系尘埃带遮挡,加上观测路线上也比较通透,所以后期数据处理要容易很多。

银心黑洞附加题二:延时摄影

虽然两个黑洞的吸积盘旋转都非常快速(甚至接近光速),但因为M87*体积足够大,因此吸积盘旋转一圈需要数天时间,而银心黑洞吸积盘旋转一圈的时间只需要数分钟。这就导致给银心黑洞拍照类似延时摄影,或在光线不好的地方给一条欢乐的小狗拍照,很难得到一张清楚的照片。

4. 如何给黑洞拍照?

好在人类拥有足够的好奇心和智慧的科学家们。在EHT 300多名工作人员跨地区跨时区的努力下克服了重重困难,最终让我们看到了宇宙中最神秘天体的样貌。

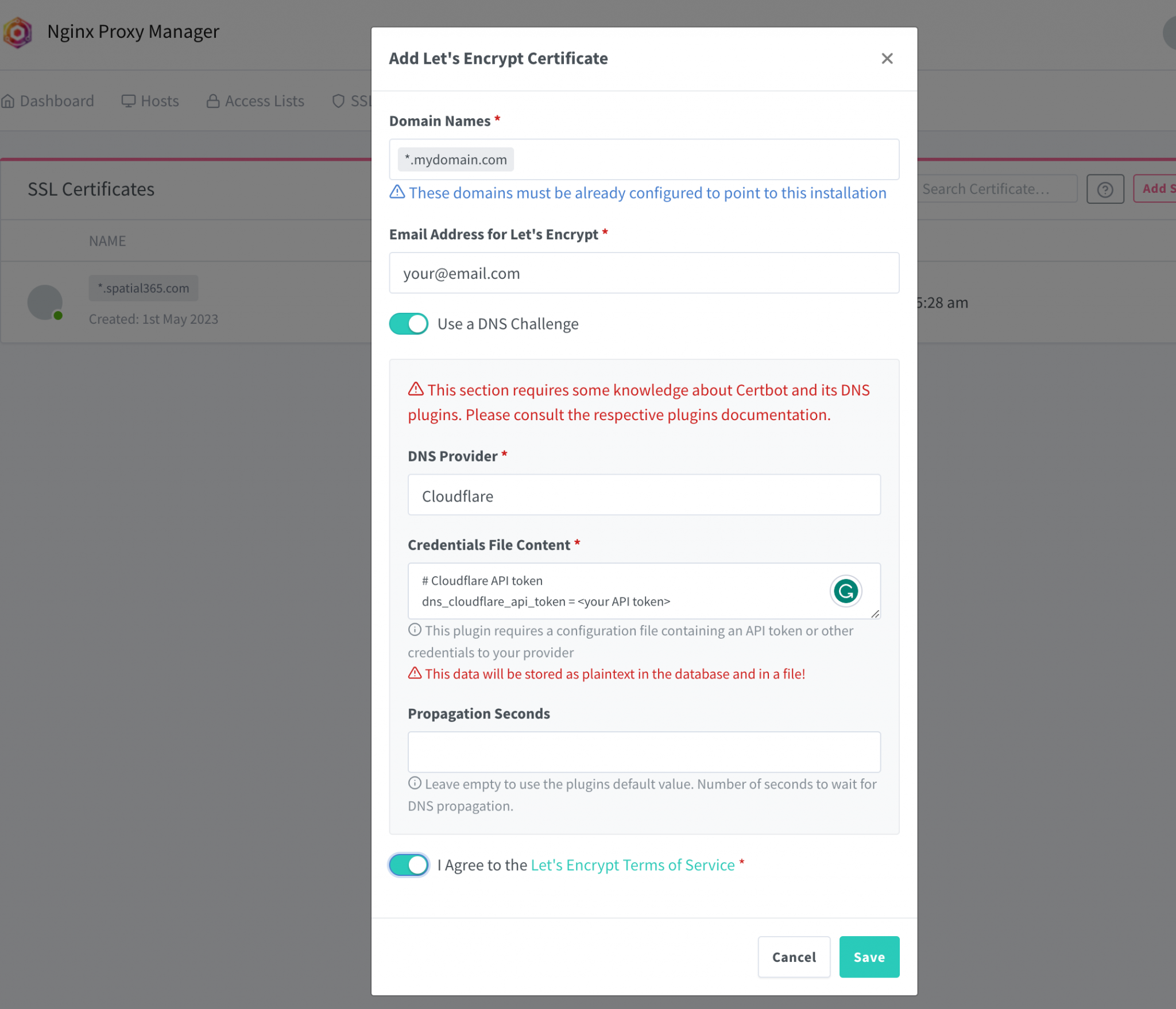

为了建造足够大的望远镜,科学家们利用了甚长基线干涉(very-long-baseline interferometry, 简称VLBI)技术。简单地说,就是将地球上不同位置的射电望远镜组成一个虚拟阵列,并通过原子钟记录观测时间/同步数据,最终虚拟出一个相当于地球大小口径的望远镜。该望远镜的角分辨率达到了20微角秒,足够从巴黎看清楚纽约一张报纸上的文字。

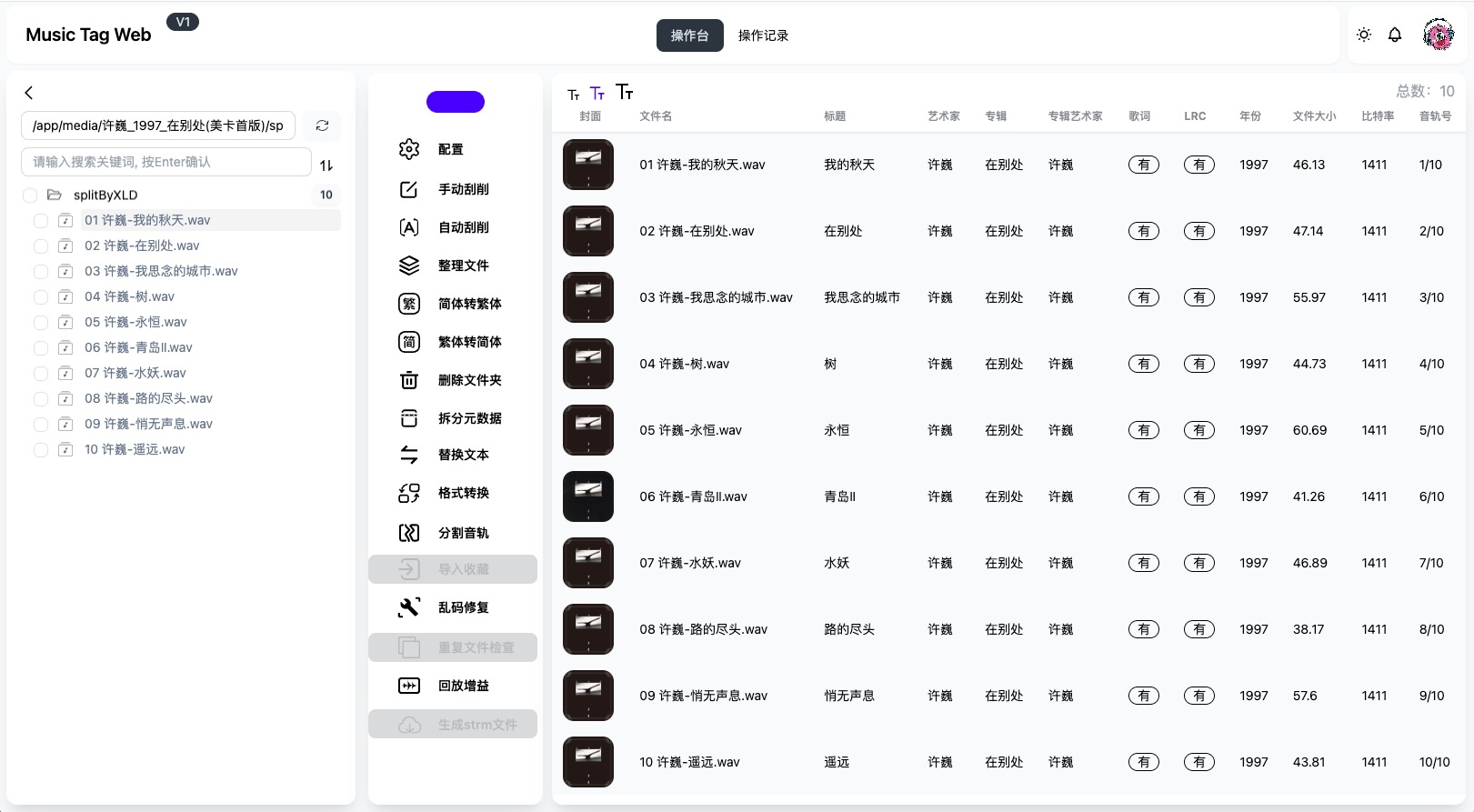

2017年4月的观测活动共有8个观测站参加,持续近10天。对于每天每个观测点350TB的数据,最终是由飞机将硬盘分别运送到德国的马克斯普朗克射电天文研究所和美国麻省理工学院海斯塔克天文台,由两地的超级计算机通过后期复杂的算法分别合并处理。

此外,EHT团队利用每次观测时间的一部分来建立模型,使得最终可以去除地球大气湍流(从地面向天空拍照的反向去云)和尘埃带对银心黑洞数据的影响。

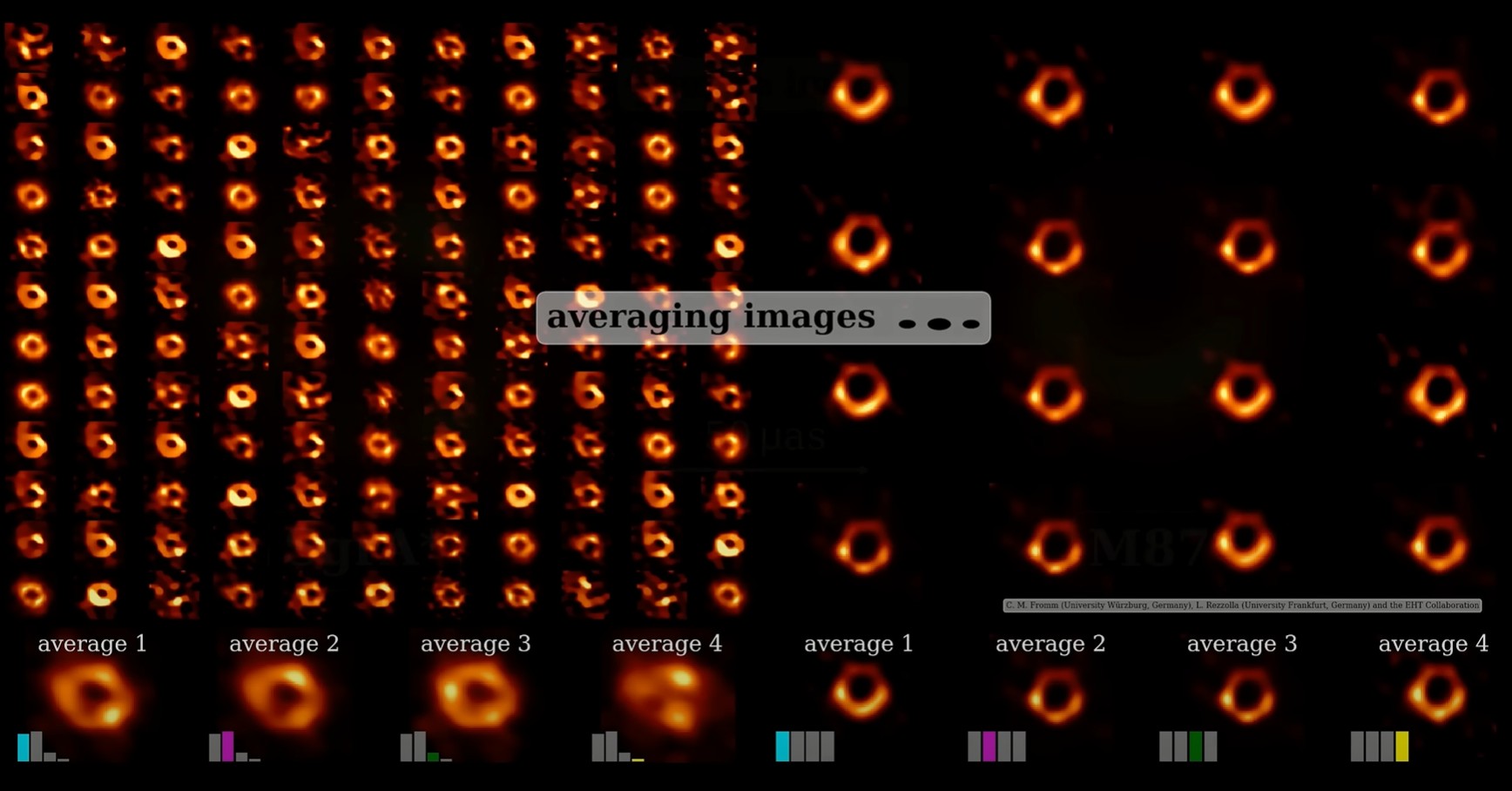

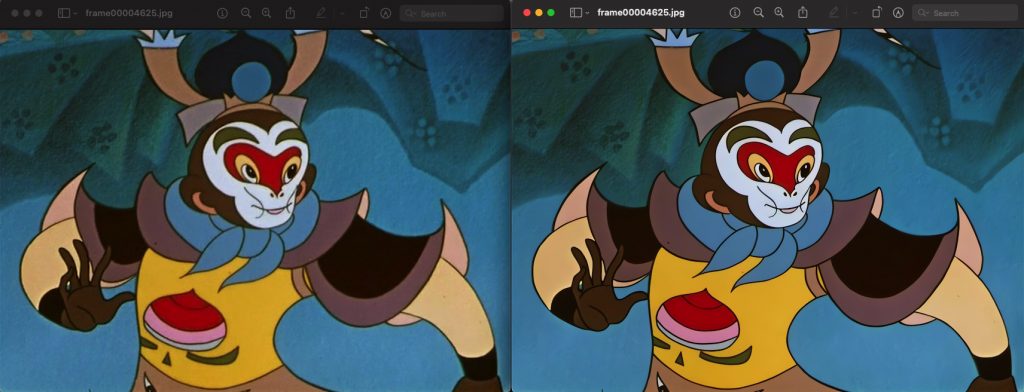

对于银心黑洞因为吸积盘旋转过快造成的“延时摄影”的问题,从下图可以看出,不同于右侧M87*多张图像比较近似,左侧银心黑洞几乎每张图像都有差异。研究人员将4组平均后的图像再次合成,得到了最终银心黑洞的照片。

5. 给黑洞拍照有什么意义?

虽然黑洞最早是由广义相对论预言存在的,但爱因斯坦本人一开始也无法相信这种天体的存在;即使到今天,天文学家普遍认为大多数星系中心几乎都存在一个超大质量黑洞,但就在2020年诺贝尔物理学奖颁给研究银河系中心的根策尔和盖兹时,也严谨地用了“超大质量致密天体”而不是黑洞的表述。

如今人类解锁了给黑洞拍照的技能,不仅直接证明了星系中心黑洞的存在,其观测结果也与广义相对论的预测惊人地吻合,再次验证了它的正确性。通过对黑洞的观测和分析,不仅能让我们更加了解这种目前宇宙中已知的最神秘的天体,也会帮助我们更多了解星系演化的过程。

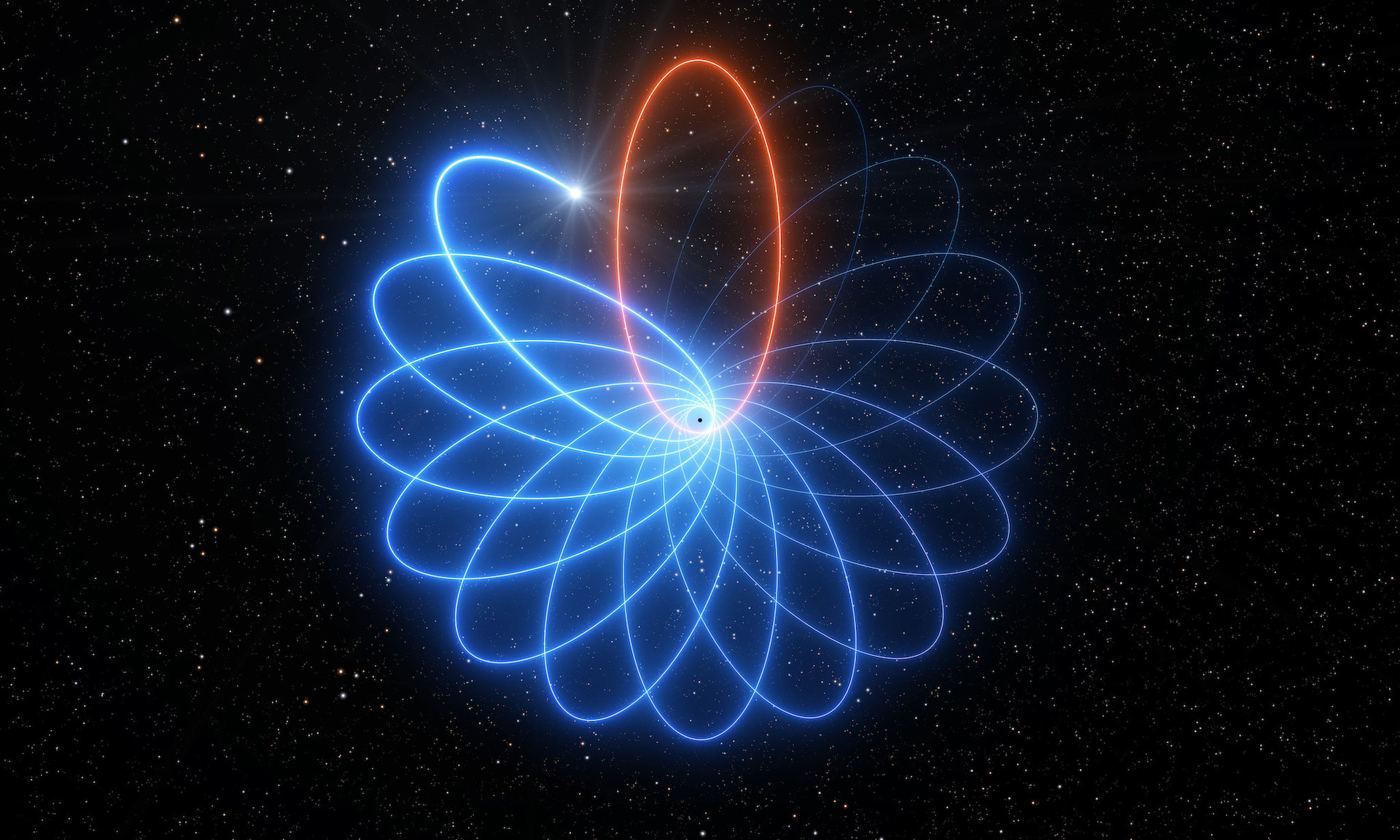

顺带一提的是,通过一项对银河系中心长达16年的研究,科学家们还绘制出了近30颗恒星围绕银心黑洞的运行轨迹。不仅如此,其中一颗名为S2的恒星,在距离银心黑洞最近点(不到200亿千米)处的移动速度达到了惊人的2500万千米/时,接近光速的3%。如果单看其中一个的话,正如广义相对论所预测的那样,它的轨道形状成花瓣状,而非牛顿引力理论所预测的椭圆形,这是由史瓦西进动效应造成的。下图是艺术家展示的恒星围绕黑洞运行的轨道图(为了更好的视觉效果有所夸大)。

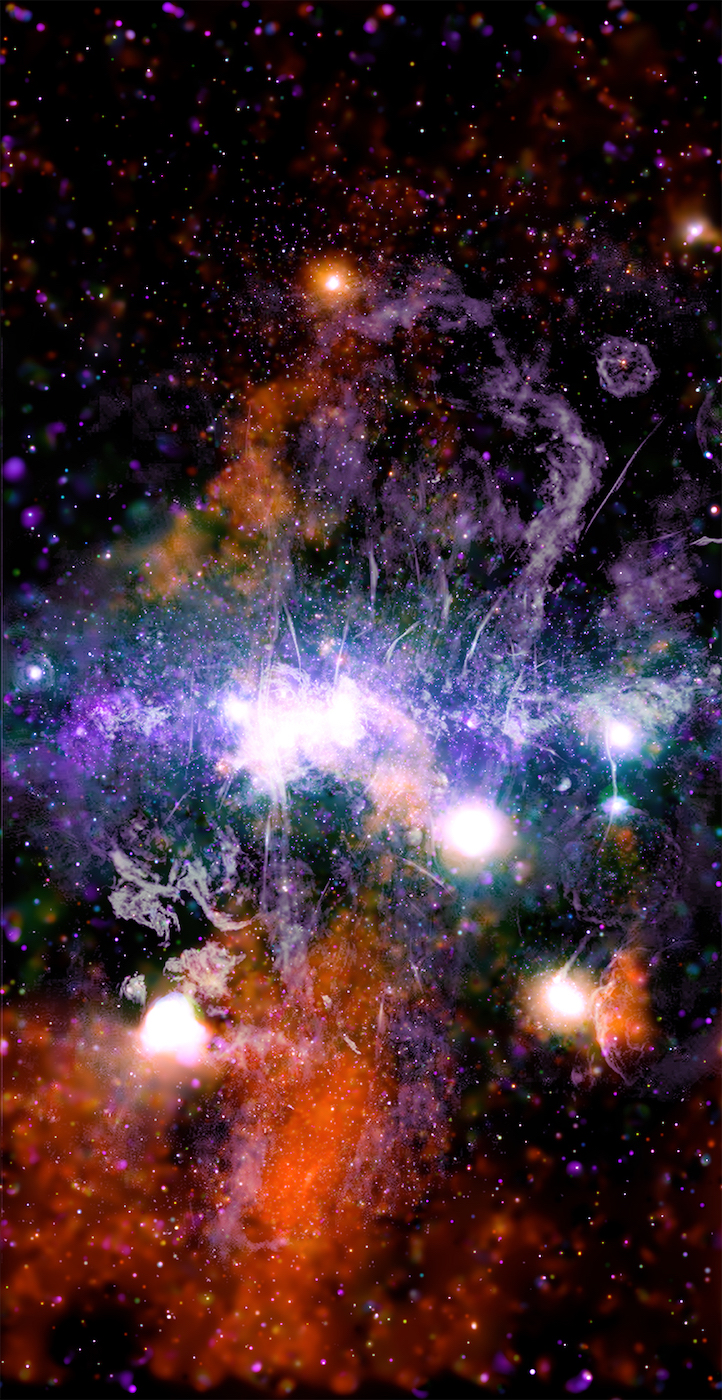

但请不要误以为银河系中心就是这种唯美的画风,实际上它远比我们想象的要“暴力“许多。下图是美国国家航空航天局(简称NASA)2021年5月公布的一张由钱德拉 X 射线天文台和南非MeerKAT射电望远镜共同观测的银河系全景图,它主要是由不同X射线波段的数据合成而来。其中包括了炽热气体喷流,各种磁场线,以及中间白色部分的银河系中心。

6. 彩蛋:黑洞是如何形成的?

黑洞的分类方法一般有两种:按照黑洞本身的物理特性(是否旋转,是否带电)分类和更常见的按照其质量体积分类。人类目前研究最多的两种黑洞就是按照质量来分类的恒星级黑洞(stellar black hole,5至数十倍太阳质量)和超大质量黑洞(supermassive black hole)。

对于恒星级黑洞的形成原因,简单来说它是由大质量恒星生命末期经历超新星爆炸(supernova)后由引力坍缩形成的。而超大质量黑洞,其质量可达太阳质量的10万倍乃至100亿倍,对于其成因目前还没有比较确定的理论。

恒星级黑洞的形成

恒星诞生是因星云内光年范围的气体和星际尘埃被扰动,物质不断向中心聚集,随着温度和压力的升高旋转坍缩而形成(剩下的“边角料”吸积会形成行星)。恒星诞生后内部主要存在两种力:自身质量产生的引力和由氢元素核聚变成氦元素过程中产生向外的推力。在主序星(main sequence star)阶段,这两种力维持平衡状态。当恒星进入生命演化末期后氢元素耗尽,意味着到氦元素的核聚变和向外的推力停止,但其自身的引力并不会消失,所以这种平衡被打破,其内核部分会像当初诞生时一样被引力压缩,内部温度和压力不断增加。当超过某个界限时,氦元素就会开始进一步核聚变。这种新的推力会使恒星的体积变成稳定时的几十倍或上百倍,即红巨星阶段。其内部温度也会高达上亿度,氦元素将快速核聚变直至成为碳元素。之后恒星已经没有足够能量来再次抗衡引力坍缩了,核心以外的外围物质会被抛散到宇宙空间中,但其最终的命运会因其自身质量不同而产生巨大差异。

当恒星的质量小于1.44倍(钱德拉塞卡极限)太阳质量 电子简并压力就会阻止其核心部分进一步坍缩从而形成稳定的白矮星(white dwarf),我们的太阳在50亿年之后就将面临此命运。推测白矮星会因能量渐渐散失最终变成黑矮星,但此过程需要的时间比现在宇宙年龄137.7亿年还长,因此现实中还没有黑矮星出现过。

当恒星质量大于1.44倍但小于大约3倍左右(奥本海默极限)太阳质量 由于自身引力过于强大,会使核心部分进一步坍缩。电子会被压入原子核,和带正电的质子中和变成中子,从而演化成中子星,这个过程通常会产生超新星爆炸现象,其亮度可短暂超过所在整个星系的亮度。中子星是除黑洞外密度最大的天体,一立方厘米体积物质的质量可达10亿吨。

其内部核聚变的过程可以一直到铁元素(到铁元素后,核聚变将不再释放能量而是需要吸收能量)。经历超新星爆炸后,其核心就会进一步坍缩成恒星级黑洞。

冷知识:根据现有理论,恒星的质量是有上限的,目前已知质量最大的恒星是太阳质量的200多倍。恒星质量越大,通常意味其寿命越短。比如著名的盾牌座UY,虽然其半径大约为太阳的1000倍,体积能容纳50亿个太阳,但质量仅为太阳的7-10倍。

超大质量黑洞形成的猜测

传统理论认为它是由普通黑洞吸引合并或星系碰撞后中心黑洞合并形成的,但这个过程相对缓慢,不足以解释那些上亿倍太阳质量黑洞的存在。近期也有新的理论认为某些星系中心直接由暗物质构成,当其密度达到临界阈值后会直接坍缩形成超大质量黑洞。最新的詹姆斯韦伯太空望远镜也许能帮助科学家们找到答案。

7. 结语

就在半个月前,NASA公布了詹姆斯韦伯太空望远镜拍摄的第一组五张图片,虽然顶着鸽王之王的头衔,但这个目前人类最强的望远镜果然没让科学家们失望。它现在正孤单一“镜”地处于地球外侧150万公里的日地拉格朗日点(Lagrangian point ,日地万有引力平衡点)L2附近。如果在将来,人类还能发射新的望远镜们到其它4个拉格朗日点上呢?我们是不是可以继续用VLBI技术得到一个近似地球轨道面积大小的虚拟望远镜?那个时候人类又将寻找怎样的拍摄目标?

我们现在知道,一颗恒星诞生于超过光年范围的气体和尘埃云,在它数以亿年计的生命中,将宇宙最原始的氢元素不断聚变,直至其消亡时以爆炸这种壮丽的方式将部分金属元素重新抛洒回宇宙空间,可能成为孕育下一颗恒星/行星的原料。这和渺小地球上的生命历程是何其相似。从某种程度上讲,正在拿着手机(含有金属元素)阅读本文的你我,本就是宇宙中的尘埃,而我们手握的却是曾经璀璨的星辰。

宇宙年龄将近138亿年,可观测宇宙半径为465亿光年,仅银河系内至少就有1000亿颗行星。在如此广袤的宇宙空间和无限的时间中,你我能够共享同一个星球,同一段时光,阅读同一篇文章,是何等的幸运……

参考资料

Astronomers Reveal First Image of the Black Hole at the Heart of Our Galaxy https://eventhorizontelescope.org/blog/astronomers-reveal-first-image-black-hole-heart-our-galaxy Astronomers reveal first image of the black hole at the heart of our galaxy https://www.eso.org/public/news/eso2208-eht-mw/ Astronomers Capture First Image of a Black Hole https://www.eso.org/public/news/eso1907/ 20 micro-arcseconds — enough to read a newspaper in New York from a café in Paris How Scientists Captured the First Image of a Black Hole https://www.jpl.nasa.gov/edu/news/2019/4/19/how-scientists-captured-the-first-image-of-a-black-hole/ First Successful Test of Einstein’s General Relativity Near Supermassive Black Hole https://www.eso.org/public/news/eso1825/ Magnetized Threads Weave Spectacular Galactic Tapestry https://www.nasa.gov/mission_pages/chandra/images/magnetized-threads-weave-spectacular-galactic-tapestry.html Stellar evolution https://en.wikipedia.org/wiki/Stellar_evolution 人類首次拍到的銀心黑洞!如何欣賞第二張黑洞特寫照片? https://www.youtube.com/watch?v=y2_VKxrqLpY 解開黑洞謎團 https://www.youtube.com/watch?v=ljhgurGJnEQ What it Takes to Image a Black Hole https://www.youtube.com/watch?v=D3m-GtAt5hY How did they actually take this picture? https://www.youtube.com/watch?v=Q1bSDnuIPbo